هوش مصنوعی؛ آینهای که تصویرِ توانایی انسان را وارونه نشان میدهد!

🌐 هوش مصنوعی؛ آینهای که تصویرِ توانایی انسان را وارونه نشان میدهد

چگونه استفاده روزافزون از AI درک ما از مهارتهای خود را تحریف میکند؟

مقدمه: انسان در مقابل آینهی هوش مصنوعی

هوش مصنوعی دیگر فقط ابزاری کمکی برای افزایش سرعت یا دقت نیست؛ تبدیل شده به همراه فکری روزمره، به مشاوری دائمی که با پاسخهای سریع و مطمئنش، ذهن ما را آرام و در عین حال خطرناکتر از گذشته کرده است. پشت این آرامش، پدیدهای روانشناختی در حال رخ دادن است: هرچه بیشتر از هوش مصنوعی استفاده میکنیم، کمتر از خودمان شناخت واقعی داریم.

پژوهشی تازه نشان میدهد که وابستگی شناختی به هوش مصنوعی (AI Cognitive Dependency) میتواند یکی از عمیقترین تغییرات روان انسانِ مدرن باشد. نهتنها اثر دانینگ–کروگر، که بر تناقض بین اعتمادبهنفس و توانایی واقعی تأکید دارد، از بین رفته؛ بلکه ساختار آن وارونه شده است.

اثر دانینگ–کروگر چیست و چرا دیگر مثل گذشته معنا ندارد؟

سالها تصور میشد سوگیری دانینگ–کروگر توضیحی برای رفتار ذهن انسان است:

افراد کممهارت بیشازحد به خود اعتماد میکنند و متخصصان معمولاً تواناییهایشان را دستکم میگیرند. این اثر در حوزههای تصمیمگیری، آزمونهای تحصیلی، کارهای شناختی و حتی زندگی روزمره قابل مشاهده است.

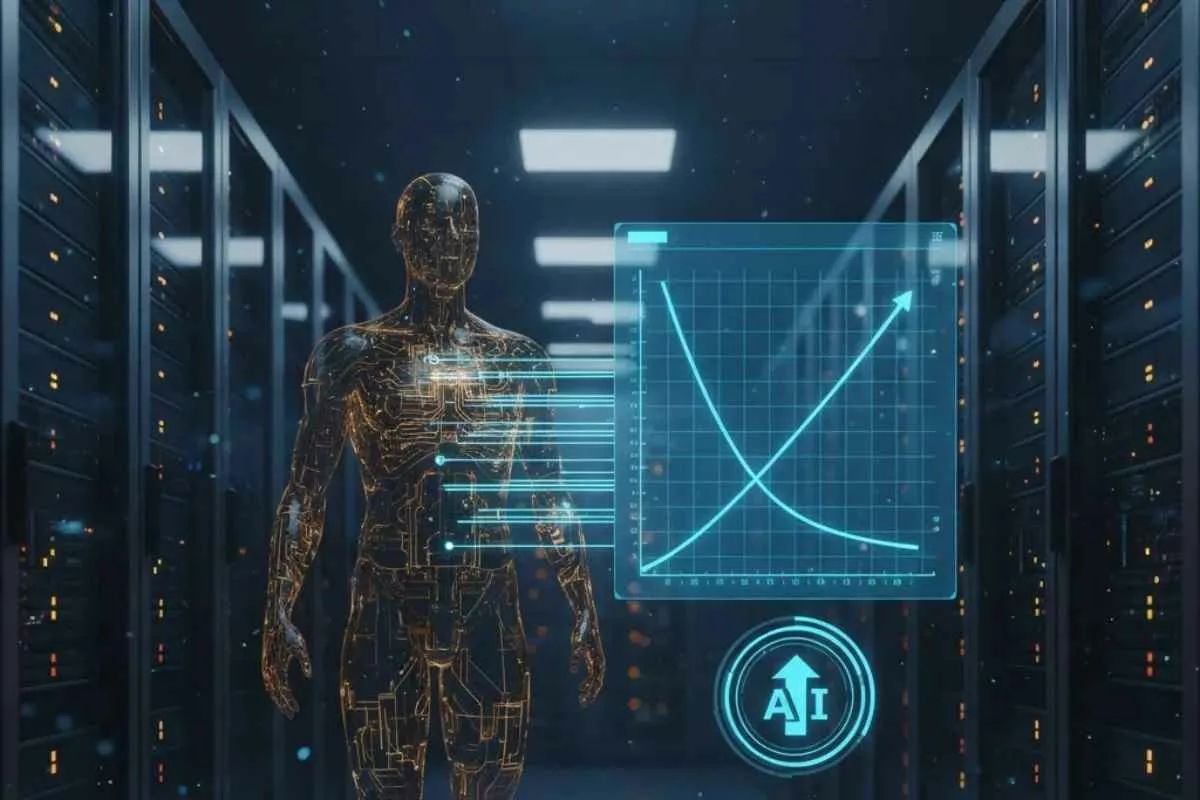

اما با ورود هوش مصنوعی، این نمودار با شیبی غیرمنتظره مسطح شده؛ کاربران کمتجربه و حرفهای تقریباً در سطحی مشابه از اعتمادبهنفس قرار گرفتهاند، و هر دو گروه عملکرد واقعی خود را بیشتر از واقعیت ارزیابی میکنند.

مطالعهی دانشگاه آلتو فنلاند؛ نقطهی آغاز یک هشدار جهانی

از سوگیری به وارونگی شناختی

در مطالعهای مشترک میان دانشگاه آلتو (فنلاند)، مؤسسه فنی کانادا و چند گروه پژوهشی در آلمان، ۵۰۰ شرکتکننده در آزمونی از نوع استدلال منطقی شرکت کردند — همان آزمونهایی که برای ورود به دانشکدههای حقوق استفاده میشوند.

نیمی از آنها اجازه داشتند از ChatGPT برای کمک استفاده کنند؛ نیمی دیگر بدون ابزار هوش مصنوعی پاسخ دادند. سپس از همه خواسته شد عملکرد خود را بهصورت ذهنی ارزیابی کنند.

نتیجه شگفتآور بود:

گروهی که با هوش مصنوعی کار کرده بود، به طور میانگین اعتمادبهنفس دو برابر بیشتر از دیگران داشت، حتی اگر پاسخهایشان اشتباهتر بود. در میان کاربران باتجربهتر، این تفاوت چشمگیرتر شد؛ آنان نهتنها تصور میکردند بهتر عمل کردهاند، بلکه به صحت پاسخهای خود اطمینان مطلق داشتند.

دکتر رابین وِلش، پژوهشگر علوم رایانه و نویسندهی اصلی مقاله، در مصاحبهای با LiveScience میگوید:

«وقتی از هوش مصنوعی استفاده میکنیم، نهتنها درک عملکرد خود را از دست میدهیم، بلکه به خطاهای خود مطمئنتر هم میشویم.»

این تحلیل، نقطهی شروعی برای بحث جهانی دربارهی توهم دقت شناختی در عصر هوش مصنوعی شد.

چرا اعتمادبهنفس کاذب در برابر هوش مصنوعی شکل میگیرد؟

۱. بارشناختیسپاری (Cognitive Offloading)

هوش مصنوعی با طراحی پاسخهای سریع و متقاعدکننده، ذهن کاربران را از فرایند تفکر عمیق دور میکند. انسان پس از دریافت پاسخ، اغلب بدون تأیید منطقی، آن را «میپذیرد».

در روانشناسی به این رفتار نوعی سپردن تفکر به دیگری گفته میشود. وقتی مغز متقاعد شود که دیگری بهتر فکر میکند، خود را از تلاش شناختی رها میسازد؛ این همان آغاز خواب شناختی است.

نتیجه؟ کاهش تمرکز، تحلیل سطحی، و در بلندمدت، ازبینرفتن حلقههای تصمیمگیری مستقل.

۲. تضعیف پایش فراشناختی (Metacognitive Monitoring)

پایش فراشناختی یعنی توانایی انسان در فکر کردن دربارهی فکر خودش؛ همان مکانیسمی که به ما اجازه میدهد بپرسیم:

«آیا مطمئنم؟ آیا استدلالم درست بود؟»

وقتی این حلقه از ذهن حذف میشود، درک ما از کیفیت کار خود تحریف میگردد. استفاده بیشتر از هوش مصنوعی، بهویژه در پرسشهای تحلیلی یا نوشتاری، باعث میشود انسان بهتدریج بازخورد درونی خود را از دست بدهد و صرفاً نتیجهی ماشینی را معیار صحت بداند.

مسطحشدن نمودار اعتمادبهنفس؛ معنای واقعی آن چیست؟

پژوهشگران نتیجه را بهصورت نمودار توصیف کردند: منحنی معروف دانینگ–کروگر که پیشتر شکل قوسی داشت، حالا به خطی تخت تبدیل شده است.

در گذشته، افراد کممهارت قلهی اعتمادبهنفس کاذب را تشکیل میدادند؛ اما حالا تمام کاربران، صرفنظر از سطح دانش، در آن قله ایستادهاند.

این به معنای آن است که:

- متخصصان واقعی، با کمک AI دیگر فروتنی شناختی خود را از دست میدهند.

- تازهکارها با سرعت بیشتری احساس برتری میکنند.

- کل جامعه در حال تبدیل شدن به مجموعهای از ذهنهای مطمئن اما سطحی است.

تاثیر اجتماعی و روانی این پدیده

از اعتمادبهنفس ناگهانی تا تصمیمهای اشتباه

در جهان امروز، هوش مصنوعی حاضر در هر حوزهای است: از پزشکی تا طراحی، از آموزش تا تحلیل داده. هرچه تصمیمها سریعتر و آسانتر میشوند، عمق فکری تصمیمگیرندگان کاهش مییابد.

- کاهش کیفیت تصمیمگیری جمعی

در تیمهای کاری که دستیارهای AI بخش تحلیل را انجام میدهند، اعضا معمولاً با توافقسازی ماشینی همراه میشوند — یعنی «اگر ماشین گفت، پس درست است». این روند اعتمادبهنفس همگانی اما سطحی را تولید میکند.

- فرسایش تدریجی مهارتهای انسانی

وقتی هوش مصنوعی تحلیل ایده، نگارش متن، یا استدلال را بر عهده میگیرد، مهارتهای سنتی تفکر نقادانه و مدیریت شناختی در انسان تضعیف میشوند. همانطور که ماشینحساب توانایی محاسبهی ذهنی را کم کرد، AI در حال کاهش توانایی کلیدیتری است: تفکر دربارهی تفکر.

- تضاد بین احساس موفقیت و واقعیت عملکرد

کاربران اغلب از خروجیهای AI، حتی ناقص، احساس رضایت میکنند؛ زیرا مغز پاداش سریع پاسخ درستنما را دریافت میکند. در نتیجه، ناحیهای از مغز مرتبط با انتقاد از خود، خاموشتر از قبل عمل میکند.

آیا راه بازگشت وجود دارد؟

پژوهشگران آلتو پیشنهاد میدهند برای کاهش اثر این وارونگی شناختی، سیستمهای هوش مصنوعی باید تفکر پرسشی را در انسان فعال کنند.

راهکارهایی مانند:

- افزودن «شاخص اعتماد» به پاسخها (Confidence Score)؛

- پرسش از کاربر: «چقدر با این پاسخ موافقی؟ چرا؟»؛

- یا حتی مدلهایی که بخشی از پاسخ را عمداً ناقص ارائه دهند تا ذهن کاربر به تحلیل بیشتر وادار شود.

این نوع طراحی، ذهن را مجبور میکند حلقهی بازخورد فراشناختی را حفظ کند، یعنی همان قابلیتی که ما را از ماشینها متمایز میکند.

نقش آموزش تفکر انتقادی در عصر هوش مصنوعی

حتی انجمن سلطنتی بریتانیا (Royal Society) در بیانیهٔ سال 2024 تأکید کرد:

«آیندهی یادگیری دیگر فقط آموزش مهارتهای فنی نیست؛ بلکه پرورش تفکر انتقادی در کنار مهارت تعامل با هوش مصنوعی است.»

در محیطهای آموزشی، بهویژه در مدارس و دانشگاهها، باید میان استفاده از هوش مصنوعی برای یادگیری و اتکای کامل به آن تمایز ایجاد شود.

برخی دانشگاههای اروپا اکنون در کارگاههای آموزشی خود، بخشهایی از تمرین را با AI و بخشهایی بدون آن برگزار میکنند تا دانشجویان تفاوت سطح واقعی خود و ذهن ماشینی را احساس کنند.

مرز نازک بین کمک و وابستگی

هوش مصنوعی در بهترین حالت، ابزاری برای توسعهی شناختی انسان است، نه جایگزین آن. زمانی این مرز شکسته میشود که ذهن دیگر نیازی به تأمل شخصی احساس نکند.

بهعبارتی، هرچه بیشتر از هوش مصنوعی استفاده کنیم، فاصلهی میان دانش و احساس دانایی افزایش مییابد.

در بلندمدت، این پدیده میتواند به ظهور نسلی از متخصصان «اطمینانزده» منجر شود؛ کسانی که بهظاهر دانا اما از نظر فراشناختی، ناتوان در نقد خود هستند.

پیام روانشناختی پژوهش

اثر دانینگ–کروگر دیگر فقط یک درس کلاس روانشناسی نیست؛ به بخش زندهای از زندگی دیجیتال تبدیل شده است.

هوش مصنوعی ما را دقیقتر، سریعتر و کارآمدتر میکند، اما همزمان از درک کیفیت آنچه انجام میدهیم، دور میسازد. این همان پارادوکس درک شناختی عصر الگوریتمها است.

پژوهش منتشرشده در مجلهی معتبر Computers in Human Behavior نتیجه میگیرد:

«اعتماد بیشازحد به فناوریهای هوش مصنوعی، نهتنها سطح مهارتها را تغییر میدهد، بلکه ادراک ما از آن مهارتها را نیز بازنویسی میکند.»

جمعبندی: آینهای که باید از آن فاصله گرفت

اگر انسان در برابر آینهای بایستد که تصویر وارونه نشان میدهد، دیر یا زود، خودِ اصلیاش را از یاد میبرد.

هوش مصنوعی همین آینه است — شفاف، سریع، و فریبنده.

برای حفظ توانایی واقعی، باید بین یادگیری با AI و قضاوت با ذهن خودمان تعادل برقرار کنیم.

راهحل ساده نیست، اما نخستین گام، آگاهی از خطای درک است: دانستن اینکه هوش مصنوعی نه فقط توان ما را بلکه درک ما را هم تغییر میدهد.

❓ سؤالات متداول (FAQ)

۱. آیا هوش مصنوعی واقعاً باعث کاهش مهارتهای شناختی انسان میشود؟

بله، پژوهشها نشان دادهاند استفاده مکرر از ابزارهای پاسخگو مانند چتباتها میتواند توانایی انسان در تحلیل مستقل و تفکر انتقادی را کاهش دهد؛ زیرا ذهن فرآیند اندیشیدن را به ماشین واگذار میکند.

۲. آیا این پدیده در تمام کاربران دیده میشود یا فقط در مبتدیها؟

طبق مطالعه دانشگاه آلتو، هر دو گروه ــ مبتدی و حرفهای ــ دچار اعتمادبهنفس کاذب میشوند. متخصصان حتی بیشتر از تازهکارها به صحت پاسخهای خود مطمئن هستند.

۳. چگونه میتوان از این اثر جلوگیری کرد؟

با طراحی سیستمهایی که کاربر را به پرسشگری و ارزیابی پاسخها تشویق کنند، و همچنین با تمرینهای تفکر نقادانه، بازگشت به فرآیند «اندیشیدن دربارهی اندیشیدن» ممکن میشود.

۴. آیا این اثر فقط در زبان و نوشتار اتفاق میافتد؟

خیر. از برنامهنویسی و طراحی گرفته تا تحلیل داده و تصمیمگیری در کسبوکار، هر جایی که هوش مصنوعی نقش مشاور یا منبع پاسخ دارد، احتمال شکلگیری اعتمادبهنفس سطحی وجود دارد.

۵. پیام اصلی پژوهش چیست؟

هوش مصنوعی میتواند عملکرد انسان را بهبود دهد، اما همزمان تصویر ذهنی او از توانایی خودش را تحریف کند. راهحل نه در پرهیز، بلکه در استفاده آگاهانه و پرسشگرانه از AI نهفته است.